Não tinha como ser diferente: como qualquer coisa contraditória que envolve a Apple, seja referente a localização ou “problemas” na antena do smartphone — independentemente se o mesmo acontece com outras empresas —, ela toma proporções hiperbólicas. Não é à toa que tais problemas ficaram conhecidos como “Locationgate” e “Antennagate”. Com a Siri, não teria por que ser diferente.

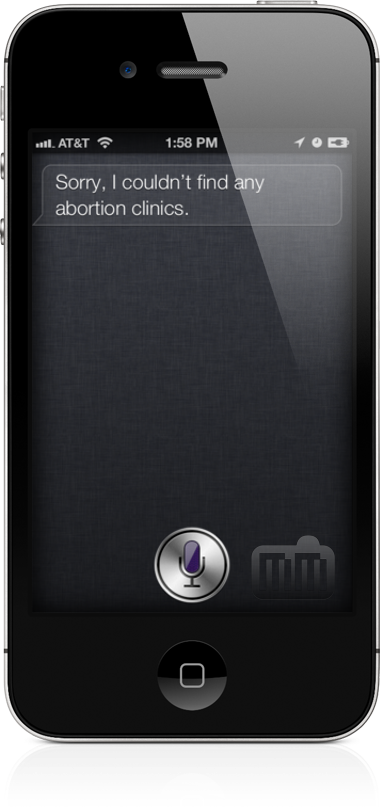

Algumas pessoas, grupos e associações — com direito a petição e tudo — estão reclamando de que a Siri consegue achar “modelos” para as necessidades sexuais, locais para comprar Viagra, clínicas para implante de seios e milhares de outras coisas que um serviço de busca entregaria como resultado. Contudo, quando o assunto é aborto, a assistente virtual parece não conseguir indicar uma clínica para seus patrões — vale lembrar que o aborto é legal nos Estados Unidos. Bastou isso para ativistas pegarem as suas pedras e mirarem a gigante de Cupertino, afirmando que ela quer “impor sua moral pró-vida goela abaixo”.

Algumas pessoas, grupos e associações — com direito a petição e tudo — estão reclamando de que a Siri consegue achar “modelos” para as necessidades sexuais, locais para comprar Viagra, clínicas para implante de seios e milhares de outras coisas que um serviço de busca entregaria como resultado. Contudo, quando o assunto é aborto, a assistente virtual parece não conseguir indicar uma clínica para seus patrões — vale lembrar que o aborto é legal nos Estados Unidos. Bastou isso para ativistas pegarem as suas pedras e mirarem a gigante de Cupertino, afirmando que ela quer “impor sua moral pró-vida goela abaixo”.

Mas será que custa analisar um pouco mais a situação, antes de sair acusando o primeiro que aparecer, como o pessoal do Gizmodo? Como muito bem colocou o TUAW, a Siri não tem inteligência própria. Para entregar os resultados, ela precisa checar um banco de dados de algum serviço — exatamente por isso que ela precisa de uma conexão com a internet. No caso de um restaurante, por exemplo, ela faz a busca pelo banco de dados do Yelp, que é bastante completo. Quando o assunto é aborto, parece que o banco usado pela assistente virtual não é tão completo assim, e os resultados não são satisfatórios. Exatamente por isso, a Apple deixou bem claro para todos que a Siri está em *fase beta* (algo raro nos produtos da Maçã), ou seja, o que estamos vendo agora não é a versão finalizada dela.

Combatendo ainda a ideia de que a Apple é o “Big Brother” e quer impor sua moral sobre nós, Chris Rawson procurou por “clínicas de aborto” e de “controle de nascimento”, encontrando resultado em cidades como Denver, Milwaukee e Nova York (para citar as mais conhecidas). Uma busca por “planejamento familiar” quase sempre traz respostas, independentemente de onde (Estado) ela é feita. Por quê? A base de dados usada para “planejamento familiar” também é do Yelp, enquanto que para assuntos de aborto, a Apple utiliza uma base mais limitada. Convenhamos, se a Siri (ou Apple) quisesse mesmo empurrar “sua ideologia pró-vida”, o resultado para “planejamento familiar” fatalmente não seria esse.

Para finalizar, questionada pelo NYTimes.com sobre o assunto, Natalie Kerris, representante da Maçã, disse: “Nossos clientes querem usar a Siri para encontrar todos os tipos de informações, e enquanto ela pode encontrar muita coisa, nem sempre poderá encontrar o desejado. Não se trata de omissões intencionais com intuito de ofender alguém. Significa apenas que, enquanto a Siri passa de produto beta para um produto final, encontraremos lugares onde ela pode ser melhorada, e faremos isso nas próximas semanas.”

Incrível como as pessoas atiram pedras antes mesmo de refletir sobre um assunto. Veremos se a declaração da Natalie acalma o pessoal…

Atualização, por Rafael Fischmann

Além da declaração da porta-voz Natalie Kerris, o próprio CEO da Apple, Tim Cook, pediu desculpas pelo ocorrido à Nancy Keenan — presidente da National Abortion and Reproductive Rights Action League (NARAL).

Nancy,

Obrigado pela sua nota.

Nossos clientes usam a Siri para encontrar todos os tipos de informações e, embora ela possa achar muitas, ela nem sempre encontra o que você quer. Essas não são omissões intencionais com o objetivo de ofender ninguém, simplesmente significa que, enquanto desenvolvermos a Siri de um produto beta para um final, encontraremos lugares onde podemos atuar melhor e faremos isso nas próximas semanas.

Agradeço por você ter chamado a nossa atenção para isso.

Saudações, Tim

Taí: pelo menos a Apple não ficou calada — aliás, se pronunciou *bem* rápido acerca do caso.

[via Blog for Choice]