Que a Siri ainda tem sérios problemas para ser vista com seriedade no mundo das assistentes digitais, ninguém há de questionar. Mas ao menos a Apple parece estar trabalhando na evolução da ferramenta, se essa pesquisa da Loup Ventures retratar bem a realidade.

Já há alguns anos, analistas da firma realizam uma espécie de pesquisa com as quatro principais assistentes digitais (Siri, Google Assistente, Alexa e Cortana) que consiste na aplicação de 800 perguntas em 5 categorias: local (que envolve recomendação de lugares próximos como restaurantes e parques); comércio (que envolve a pesquisa e compra de itens pela assistente); navegação (que envolve o sistema de navegação do aparelho); informação (com perguntas comuns sobre acontecimentos e pessoas); e comando (que configura ações no dispositivo como um alarme ou lembrete).

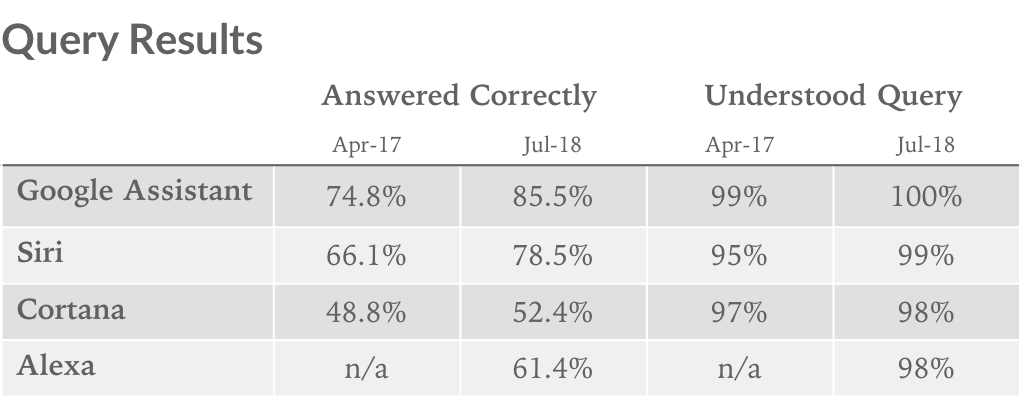

Os resultados, então, são analisados sob dois fatores: se a assistente entendeu a pergunta e, em seguida, se ela a respondeu corretamente. Comparando as respostas obtidas em 2017 e 2018, a firma chegou à conclusão de que a Siri teve, sim, uma evolução considerável em um ano: em abril de 2017 ela tinha entendido 95% das perguntas e respondido corretamente 66,1% delas; na pesquisa mais recente, 99% dos requerimentos foram entendidos e 78,5% deles, respondidos corretamente.

Os números crescentes, ainda assim, não são páreos para o Google Assistente, que na última checagem teve um índice de 100% em entendimento total, e respondeu corretamente a 85,5% das perguntas. A Siri, entretanto, é agora a segunda colocada na pesquisa:

É bom notar que Cortana e Alexa têm uma certa desvantagem na medição: enquanto Siri e Google Assistente foram testadas em seus ambientes “domésticos” (ou seja, a primeira num iPhone e a segunda num Pixel XL), as assistentes da Microsoft e da Amazon foram submetidas às perguntas através de seus aplicativos para iOS. É de se questionar se os resultados seriam os mesmos se o teste fosse aplicado num Windows Phone e num Amazon Echo, por exemplo.

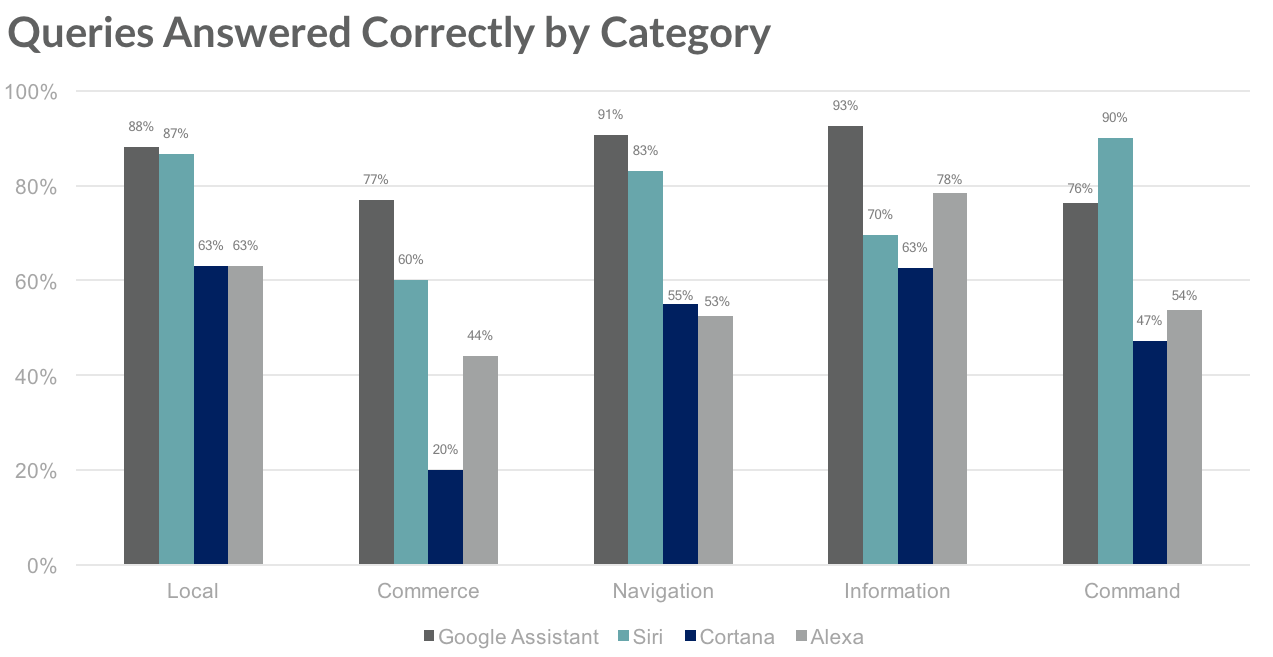

Dividindo as perguntas em suas categorias, é possível notar que apenas em uma a Siri superou a sua concorrente de Mountain View — a de “comandos”, o que mostra que a empreitada da Apple em tornar a sua assistente mais proativa dentro dos domínios do iPhone tem sido frutífera. A assistente da Apple, por outro lado, perdeu o segundo lugar na categoria “informação” para a Alexa.

Segundo os pesquisadores, a tendência é que as assistentes digitais continuem melhorando exponencialmente, já que as empresas estão cada vez melhores na remoção do principal obstáculo enfrentado por elas: a interpretação contextual correta da questão realizada. A Loup Ventures arrisca que duas categorias que entrarão com força nas ferramentas nos próximos tempos são as de aplicativos de carona, como o Uber, e de pagamentos.

Claro, nós aqui devemos levar em conta que essas medições todas são feitas em inglês — se o teste fosse realizado no nosso velho e bom português, certamente teríamos resultados muito diferentes e inferiores. Será que levará tempo até que outros idiomas se equiparem à língua-mãe das assistentes?