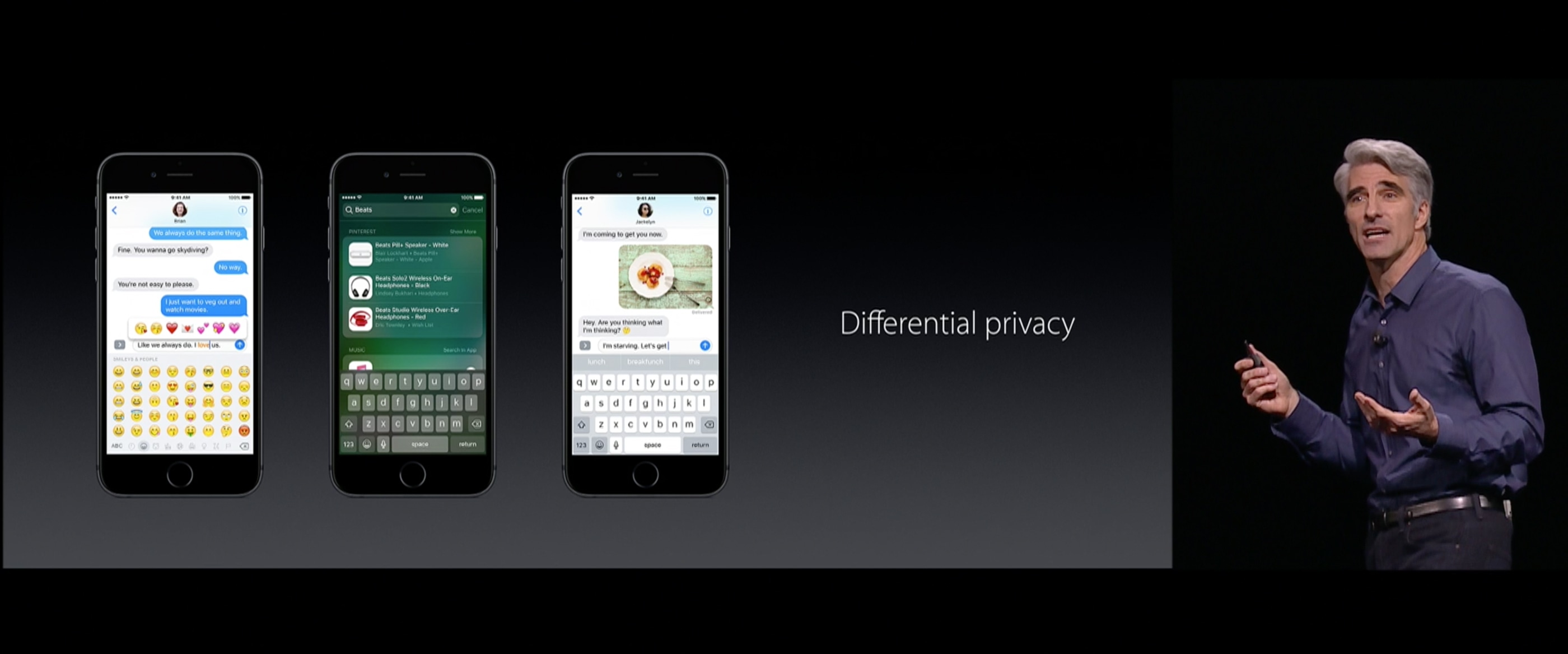

Privacidade é um dos tópicos que a Apple mais gosta de falar, de se gabar. Ontem, durante a WWDC 2016, Craig Federighi (vice-presidente sênior de engenharia de software da Maçã) citou o fato de a empresa ter um método chamado “privacidade diferencial” (differential privacy) e deu a seguinte explicação:

Nós acreditamos que vocês deveriam ter ótimos recursos e privacidade. Privacidade diferencial é um estudo na área de estatística e análise de dados que utiliza tabelas de dispersão (hashing), sub-amostragem (subsampling) e adição de ruídos (noise injection) para permitir a aprendizagem coletiva (crowdsourced learning) de modo que ainda mantenha os dados dos usuários totalmente privados. A Apple vem fazendo um trabalho super-importante nesta área para permitir que a privacidade diferencial seja implantada em grande escala.

Como a conferência é para desenvolvedores, todos provavelmente o entenderam bem. Porém, para quem é leigo, o que isso significa? A WIRED explicou de um modo que todos entendam:

Privacidade diferencial, traduzido da fala da Apple, é a ciência estatística que tenta aprender o máximo possível sobre um grupo enquanto aprende o mínimo possível sobre os indivíduos neste grupo. Com a privacidade diferencial, a Apple pode coletar e guardar os dados dos seus usuários em um formato que permite recolher informações sobre o que as pessoas fazem, dizem, gostam e querem. Porém, não pode retirar nenhum dado sobre uma pessoa específica que possa qualificar uma violação de privacidade. Em teoria, isso também não poderia ser feito nem por hackers nem por agências de inteligência.

Ao ser questionado pela WIRED, um representante da Maçã explicou que eles adicionam “ruídos matemáticos” (mathematical noises) aos padrões de grupos menores, o que dificultaria a coleta de dados de um indivíduo. Isso significa que, quanto mais as pessoas compartilham de uma mesma informação, mais estes dados formarão um padrão geral para que possa ser usada para melhorar a experiência do usuário.

O professor de criptografia da Universidade John Hopkins tweetou sarcasticamente, sugerindo que a Apple teria ido da “teoria” para a liberação ao público, esquecendo da prática. Ele explicou para o Gizmodo, dizendo que a ideia é ótima mas que ele nunca havia visto ela sendo realmente aplicada sem que sacrifique um dos dois lados: ou a privacidade ou a precisão na coleta de dados.

Apesar disso, a Apple trouxe para o seu lado o professor de ciências da computação da Universidade da Pensilvânia, Aaron Roth, que teria escrito um livro sobre essa tecnologia de privacidade. Durante a keynote, Craig disse que teria demonstrado a Roth a metodologia aplicada e ele aprovou, dizendo ser “visionária”. Apesar de não poder comentar sobre o pouco que pôde ver, ele contou à WIRED acreditar que a Apple está “fazendo isso corretamente”.

[via 9to5Mac]